EVA x Rebellions: Journey of EVA on NPU

Mellerikat EVA와 Rebellions NPU의 통합 및 최적화 과정은 차세대 AI 인프라가 나아갈 방향을 명확히 보여주었습니다. 이번 프로젝트를 통해 우리는 NPU 기반 아키텍처가 기존 GPU 중심 인프라의 고비용·고전력 문제를 해결할 수 있음을 입증했습니다. 특히 실시간 인지(Perception)와 추론(Reasoning)이 핵심인 피지컬 AI(Physical AI) 환경에서 막대한 TCO(Total Cost of Ownership) 절감과 고성능을 동시에 달성할 수 있는 잠재력을 확인했습니다.

오늘은 많은 분이 궁금해하시는 GPU 모델을 NPU로 옮기는 '포팅(Porting)' 과정과 그 뒤에 숨겨진 기술적 과제들을 공유하고자 합니다.

1. GPU 모델의 NPU 포팅(Porting) 과정

NPU는 특정 연산에 최적화된 구조를 갖추고 있어, 새로운 모델이 출시되어도 즉시 실행하기 어렵습니다. 따라서 하드웨어의 잠재력을 최대한 이끌어내기 위해 다음과 같은 필수 단계를 거칩니다.

-

모델 변환 (Model Conversion) PyTorch나 TensorFlow로 개발된 원본 모델을 NPU가 이해할 수 있는 실행 형식으로 변환합니다. Rebellions의 ATOM Compiler를 통해 모델의 연산 그래프(Computational Graph)가 분석되고, NPU 아키텍처에 맞는

.rbln실행 형태로 변환됩니다. -

NPU 최적화 컴파일 (Optimizing Compilation) Rebellions SDK(RBLN SDK)의 컴파일러를 통해 하드웨어 맞춤형 실행 파일로 컴파일합니다.

- 그래프 최적화: 불필요한 연산을 제거하고 데이터 흐름을 재배치합니다.

- 연산 융합 (Operator Fusion): 여러 작은 연산을 하나의 큰 커널로 합쳐 메모리 접근 횟수와 오버헤드를 줄입니다.

- 데이터 레이아웃 최적화: NPU 메모리 구조에 맞춰 텐서 배치를 변경하여 접근 속도를 높입니다.

-

양자화 (Quantization) NPU 아키텍처에 맞는 연산 정밀도를 적용하여 성능과 메모리 효율을 개선합니다. EVA의 경우 FP16 기반 추론 환경을 기준으로 안정적인 성능을 확보하도록 최적화했습니다.

-

vLLM 통합 및 검증 최적화된 모델을 vLLM-RBLN 서빙 프레임워크에 이식합니다. TTFT(첫 토큰 생성 시간)와 Throughput(처리량) 등 핵심 지표를 측정하며 GPU 환경과 비교 검증을 수행합니다.

2. EVA Application 최적화 및 기술적 과제 해결

포팅된 파운데이션 모델 위에 실질적인 서비스인 EVA Application을 올리는 과정에서는 다음과 같은 구체적인 최적화 로드맵을 실행하고 있습니다.

-

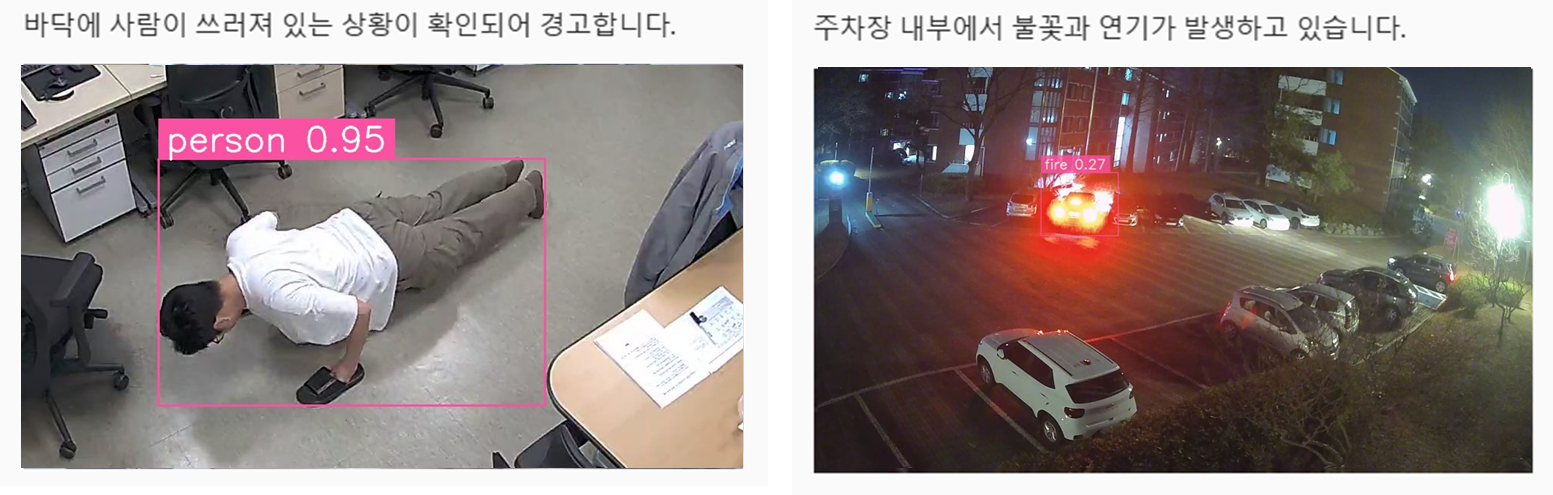

EVA Vision 최적화 (1:1 Mapping & Batching) NPU 코어와 Vision Worker를 1:1로 매핑하여 컨텍스트 스위칭 오버헤드를 제거했습니다. 또한 Continuous Batching 기술을 응용하여 수백 대의 카메라 데이터를 지연 없이 실시간으로 처리할 수 있는 기반을 만들고 있습니다.

-

EVA Agent 최적화 (VLM 부하 절감) VLM(Vision-Language Model)의 입력 해상도를 1280x720으로 표준화하고, 2단계 추론(Two-Stage Reasoning) 구조를 활용해 불필요한 VLM �호출 횟수를 최소화했습니다. 이는 고비용 연산인 Vision Encoder의 부하를 즉각적으로 줄여줍니다.

-

시스템 메모리 관리 및 KV Cache 최적화 Rebellions와 협력하여 vLLM-RBLN 인스턴스의 메모리 사용 패턴을 분석하고, 페이지 단위 메모리 관리 구조를 기반으로 자원 활용 효율을 개선하고 있습니다. 이를 통해 동일한 하드웨어 환경에서도 더 많은 시각 데이터를 안정적으로 처리할 수 있도록 최적화를 진행하고 있습니다.

-

VLM Vision Encoder 병렬 처리 VLM 추론에서 큰 연산 비중을 차지하는 Vision Encoder 단계의 병렬 처리 구조를 개선하고 있습니다. Vision Encoder 연산이 여러 NPU 코어에 효율적으로 분산 실행되도록 최적화하여 VLM 서빙 처리량 향상을 목표로 하고 있습니다.

3. 결론: PoC를 넘어선 상용 제품으로의 진화

우리는 스트레스 테스트를 통해 발견된 기술적 과제들을 하나씩 해결해 나가며, 리소스를 최대 활용하는 최적화 작업을 지속하고 있습니다. Rebellions와의 긴밀한 협력을 통한 Vision Encoder 병렬 처리, 그리고 EVA 플랫폼의 지능형 스케줄러 개발에 이르기까지 모든 단계는 'EVA on NPU' 솔루션을 단순한 기술 검증(PoC) 수준을 넘어 상용 제품으로 완성시키는 과정에 있습니다.

결국 AI 서비스의 성공은 경제성, 확장성, 서비스 품질이��라는 세 가지 조건을 모두 충족하는 데 있습니다. EVA는 앞으로도 최신 NPU 기술을 적극 수용하여, 고객에게 가장 경쟁력 있는 TCO와 압도적인 성능을 갖춘 Physical AI 플랫폼의 글로벌 표준을 제시하겠습니다.